La chaîne publique allemande ZDF a appelé un correspondant américain fin février après la parution d’un clip généré par l’IA dans un reportage sur les agents américains de l’Immigration and Customs Enforcement (ICE).

PUBLICITÉ

PUBLICITÉ

La chaîne s’est excusée d’avoir utilisé le clip, qui montrait des enfants accrochés à leur mère alors qu’elle était arrêtée par des agents de l’ICE. La vidéo avait un filigrane Sora, indiquant clairement qu’elle a été créée par l’outil vidéo d’OpenAI.

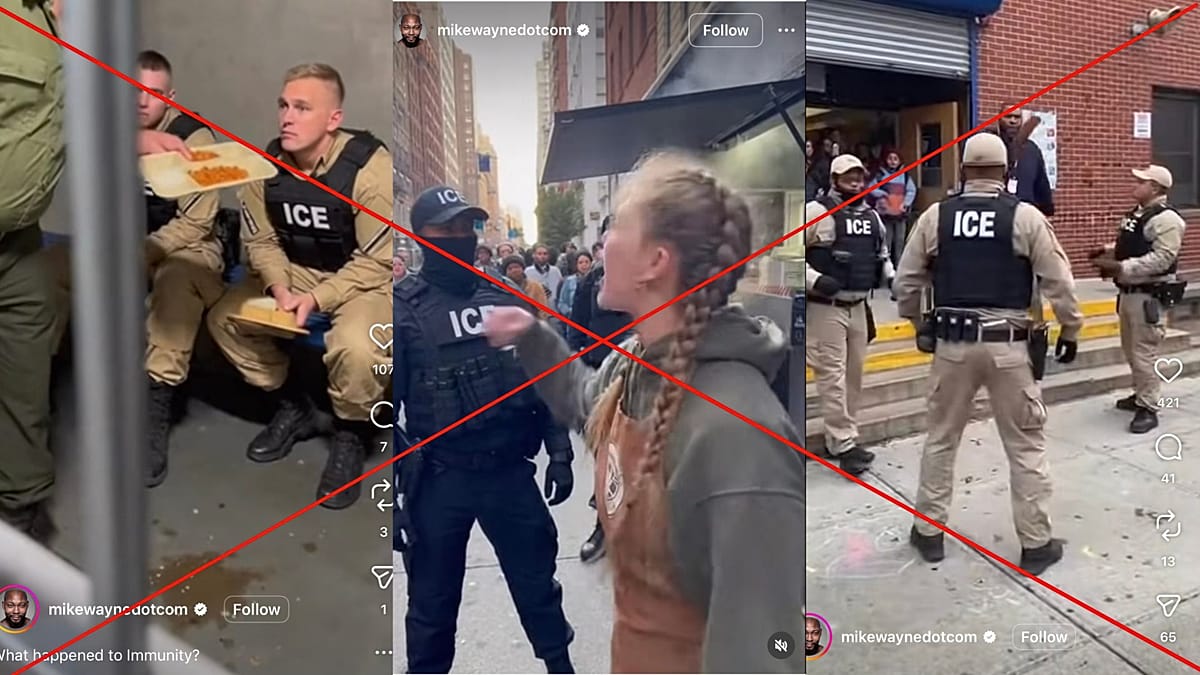

Le Cube, l’équipe de vérification des faits d’Euronews, a découvert que la vidéo est l’un des milliers de clips d’agents de l’ICE générés par l’IA qui inondent les réseaux sociaux, la plupart d’entre eux sans étiquetage clair et accumulant collectivement des millions de vues.

Modèle cohérent

Les données partagées avec The Cube par la société de détection d’IA TruthScan montrent plus de 200 courts clips montrant des agents de l’ICE poursuivis par des enseignants, se battant dans des bars et arrêtés par le NYPD (New York City Police Department) dans le métro.

TruthScan a déclaré avoir supprimé plus de 200 vidéos d’un seul compte Instagram. Les vidéos sont courtes, dramatiques et chargées d’émotion.

Le Cube a découvert que le compte publie toujours en masse des clips ICE générés par l’IA, certains obtenant des milliers et d’autres des millions de vues.

Il existe plusieurs indices expliquant pourquoi les vidéos ne sont pas réelles : dans un exemple, de la vapeur semble s’élever sur une surface solide lors d’une confrontation entre un agent de l’ICE et un employé de café, signe subtil que le clip est synthétique.

Selon TruthScan, chaque vidéo durait exactement 10 ou 15 secondes, ce qui suggère fortement qu’elles ont été générées à l’aide du modèle vidéo Sora 2 d’OpenAI, qui offre des options vidéo de 10 ou 15 secondes aux utilisateurs.

Contrairement à de nombreuses vidéos générées par l’IA qui contiennent un filigrane, la plupart de ces clips ICE n’en contiennent pas.

De même, en novembre de l’année dernière, 404 Media a rapporté que des clips d’agents ICE générés par l’IA à partir d’un compte Facebook sont devenus virauxet l’un d’eux a généré à lui seul 4 millions de vues. Les vidéos ont depuis été supprimées.

Risque accru pour la confiance du public

Les experts affirment que le risque s’étend au-delà des clips individuels mal étiquetés, à la prolifération plus large de faux contenus sur des sujets politiques sensibles, qui peuvent miner la confiance du public.

“Il existe un risque important dans les réponses collectives aux actions des forces de l’ordre, à la fois négatives et positives”, a déclaré Ari Abelson, co-fondateur d’OpenOrigins, une société d’authenticité médiatique qui détecte les deepfakes.

“C’est une préoccupation pour les forces de l’ordre qui veulent conserver leur confiance, mais c’est également important pour les institutions qui les tiennent responsables lorsqu’elles dépassent leurs limites”, a déclaré Abelson au Cube.

Comme pour le streaming ZDF, le contenu ICE généré par l’IA ne se limite pas aux comptes anonymes. Parfois, cela atteint même les plus hauts niveaux de la fonction publique.

En janvier, la Maison Blanche a publié une image modifiée numériquement de la militante et avocate Nekima Levy Armstrong après son arrestation lors d’une manifestation liée à l’ICE au Minnesota.

Une analyse montre que l’image modifiée montre Armstrong avec une peau plus foncée et visiblement sanglotant par rapport à l’image originale.

La Maison Blanche a répondu aux questions sur la manipulation de l’image avec un message du directeur adjoint de la communication, Kaelan Dorr, déclarant : « UNE FOIS ENCORE, aux personnes qui ressentent le besoin de défendre par réflexe les auteurs de crimes odieux dans notre pays, je partage ce message : l’application de la loi continuera. Les mèmes continueront. »

Armston a déclaré qu’elle était “dégoûtée” par la Maison Blanche pour avoir publié l’image.

Selon Abelson, le problème survient s’il manque des barrières de sécurité (ou des garanties) qui indiquent clairement que le contenu est faux.

“Les caricatures politiques ont toujours été utilisées en politique, et elles le sont de manière très similaire”, a-t-il déclaré. “La principale différence réside dans le degré d’hyperréalisme des vidéos.”

“Les espaces sociaux et d’information nécessitent une chose : la capacité de prouver qu’une photo et une vidéo sont réelles, afin que nous puissions apprécier les fausses comme des fictions et ressentir la gravité des événements réels”, a-t-il ajouté.